Случалось вам полностью терять трафик с Яндекса или Google на проекте, которому было отдано много пота и крови? Еще нет? Тогда вы вовремя открыли эту статью. Дочитайте до конца и намотайте на ус – возможно, она сбережет вам тонну-другую нервных клеток.

Сразу успокою: хотя сильная просадка посещаемости крайне неприятна в эмоциональном и финансовом плане, с ней почти всегда можно бороться. Неизлечимых случаев мало. На худой конец можно учесть ошибки и стартовать с новым доменом. Более того, сильное падение трафика обычно вызвано причинами, которые лежат на поверхности. Их может найти практически любой SEO-специалист, на эту тему много статей и докладов.

Скрытая угроза: страницы, потерявшие поисковый трафик

Поэтому сегодня мы поговорим о другом. Не об экстренном лечении, а о профилактике. Любой проект может терять посещаемость на микро-уровне – перестают приносить трафик отдельные страницы. Общая посещаемость при этом может стабильно расти за счет других документов.

Большинство сколько-нибудь крупных сайтов (от пары сотен url) постепенно накапливают проблемные страницы. Их обязательно нужно найти и разобраться в ситуации. Почему “обязательно”? Все просто:

- во-первых, вернуть трафик обычно куда легче, чем завоевать новый;

- во-вторых, мелкие неприятности с отдельными страницами зачастую свидетельствуют о более серьезных угрозах сайту. А значит – помогают их диагностировать на ранней стадии и избегать больших потерь;

- в-третьих, это позволяет держать руку на пульсе ниши и принимать более эффективные решения по развитию сайта.

Вообще говоря, отслеживание проблемных страниц разных типов – это рутинная задача SEO-специалиста. Она входит в джентльменский набор обязательных для мониторинга параметров.

Как найти url, переставшие давать посетителей с поиска

Когда я несколько лет назад серьезно занялся консультированием по SEO, меня сильно удивило отсутствие на рынке инструментов, которые бы автоматизировали задачу. Пришлось написать собственный скрипт, работавший со статистикой Метрики. Он стал первым из тех, что потом легли в основу сервиса https://bez-bubna.com/. Если вы пользуетесь сервисом, то он сделает все за вас – второй раздел аудита называется “Потерянный трафик”, там есть списки страниц, потерявших трафик с Яндекса и Google. Просто скачиваете их и переходите к анализу проблем (см. ниже о том, как найти и устранить причины выпадения).

Разумеется, в создании этих списков нет ничего сложного (сервис не зря называется “без бубна”). Вы можете сделать их и вручную, хотя это и слегка муторно. Вот инструкция.

1. Выгружаем страницы входа за последний месяц

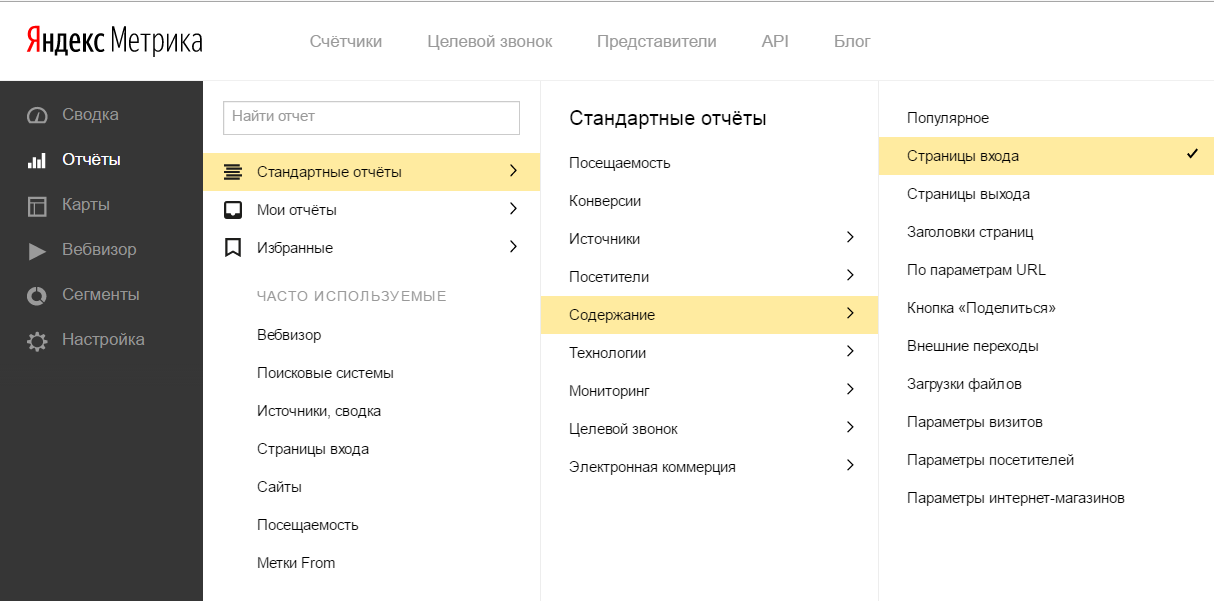

Отчет “Страницы входа” – стандартный для Яндекс.Метрики:

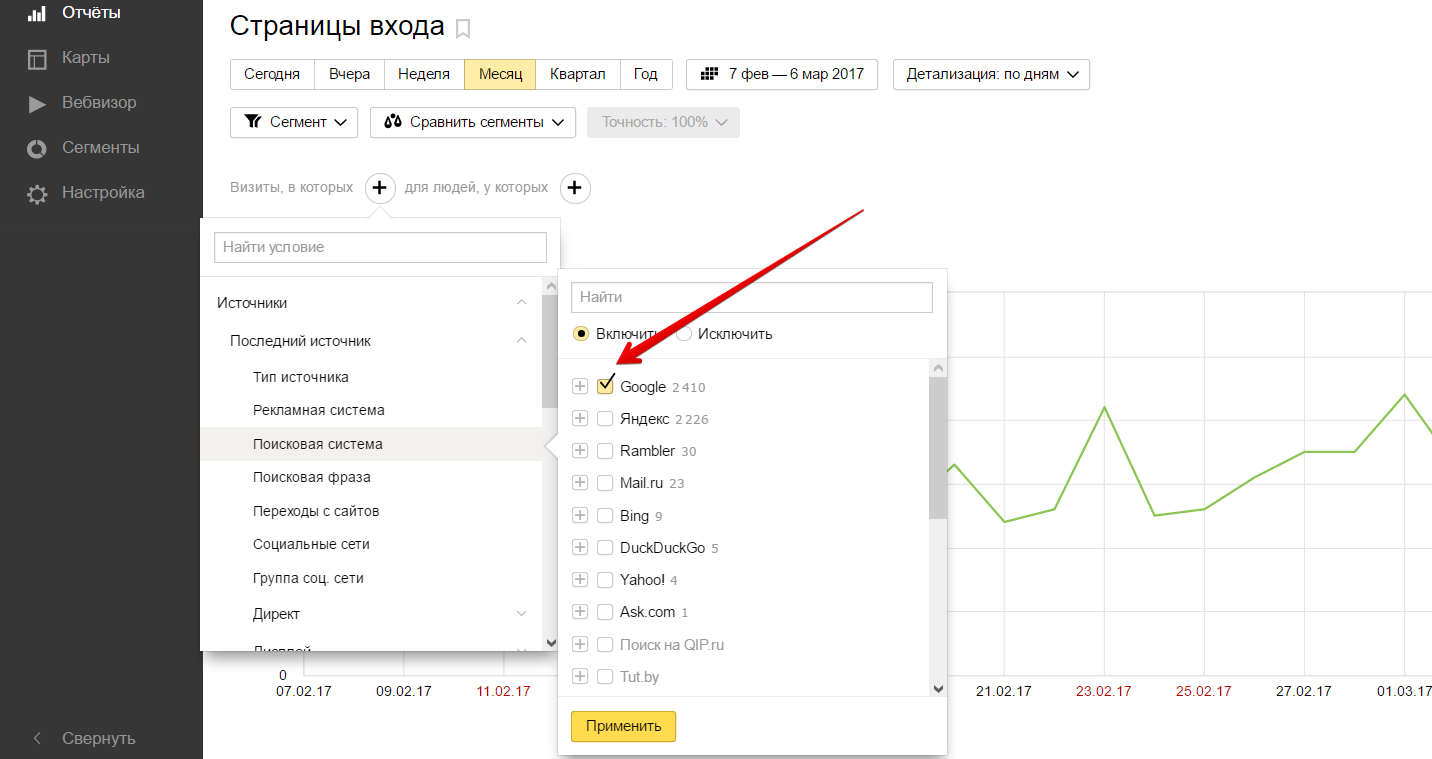

Не забываем указать, что нам нужен трафик только с одной поисковой системы:

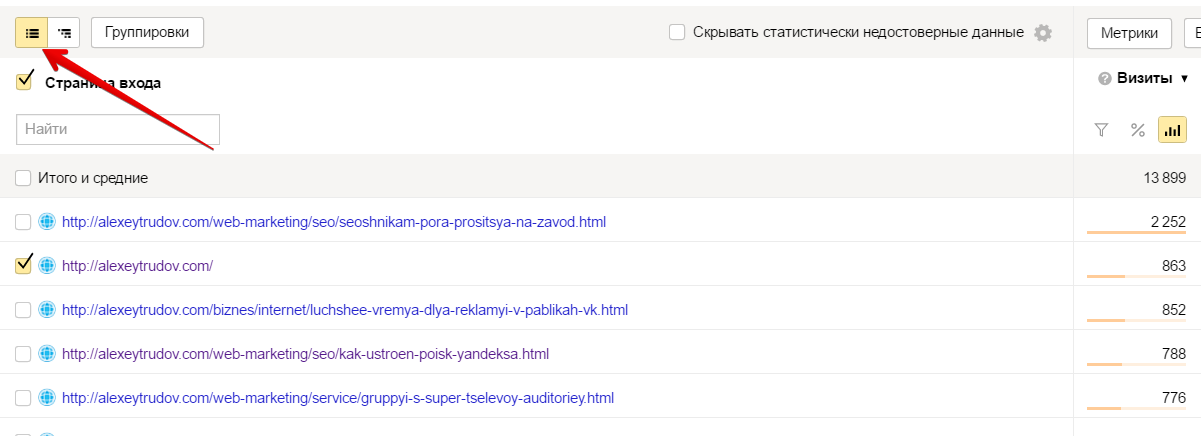

Переключимся на на линейный список, чтобы в выгрузку попали только нужные данные:

Теперь можно выгружать в Excel (кнопка вверху справа – “данные таблицы”).

2. В том же самом отчете меняем период на более длинный и снова выгружаем.

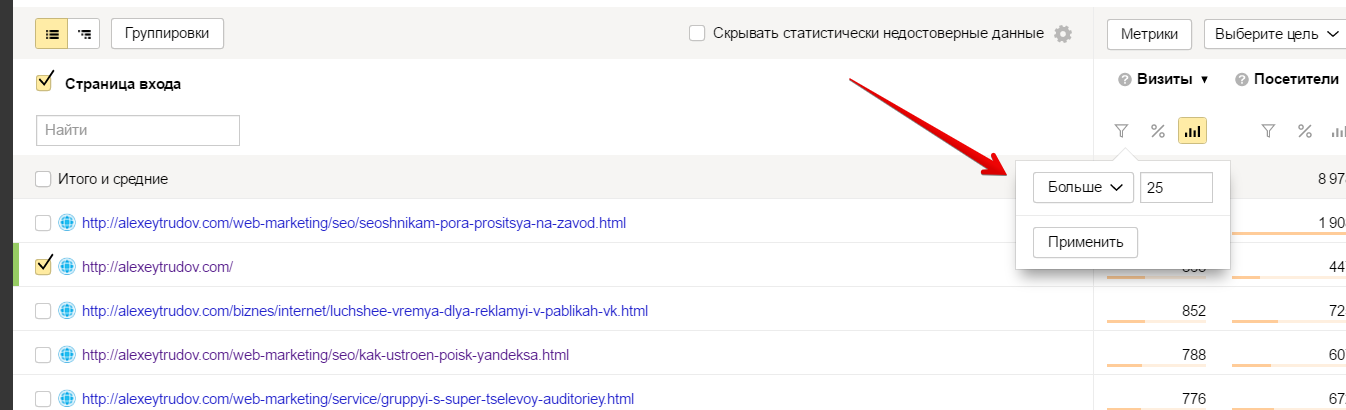

Например, берем 12 месяцев. Теперь нам нужно отфильтровать страницы, которые имеют слишком маленький трафик. Ведь если посещаемость изменится с 2 человек в год до 0 в месяц – это еще мало о чем говорит. А вот если на конкретный url c Яндекса пришло 200 человек за год и 0 за месяц – значит, что-то не так.

В зависимости от размера сайта минимальный годовой трафик, который следует принять во внимание, будет разным. Для небольшого проекта можно использовать 25 визитов, для среднего – 50. Указываем этот лимит в настройках:

3. Сравниваем списки между собой

Нам нужно найти те, что есть в списке “за год” и отсутствуют в списке “за месяц”.

Вы можете сделать это с помощью Excel (Google в помощь). Лично мне в нем работать не комфортно, я не считаю Excel универсальным рабочим инструментом. Поэтому сделал специальный онлайн-сервис, который решает задачу в один клик: https://bez-bubna.com/free/compare.php (бесплатно, без регистрации). Просто копируете один список в правое поле, второй – в левое и нажимаете кнопку “Найти различие”.

Теперь повторим процедуру для второй поисковой системы. Итак, у нас на руках два списка url – утратившие посетителей с Google и с Яндекса. Что делаем дальше?

Как найти причину, по которой пропал трафик и вернуть его

Разумеется, причин потери трафика может быть очень много. Не все свидетельствуют о проблемах и требуют действий. Рассмотрим самые распространенные варианты. Мы будем проводить анализ в таком порядке, чтобы сначала делать самую простую работу (а вдруг сложная и не потребуется?).

Итак, гипотезы:

Смена адреса страницы или техническая ошибка

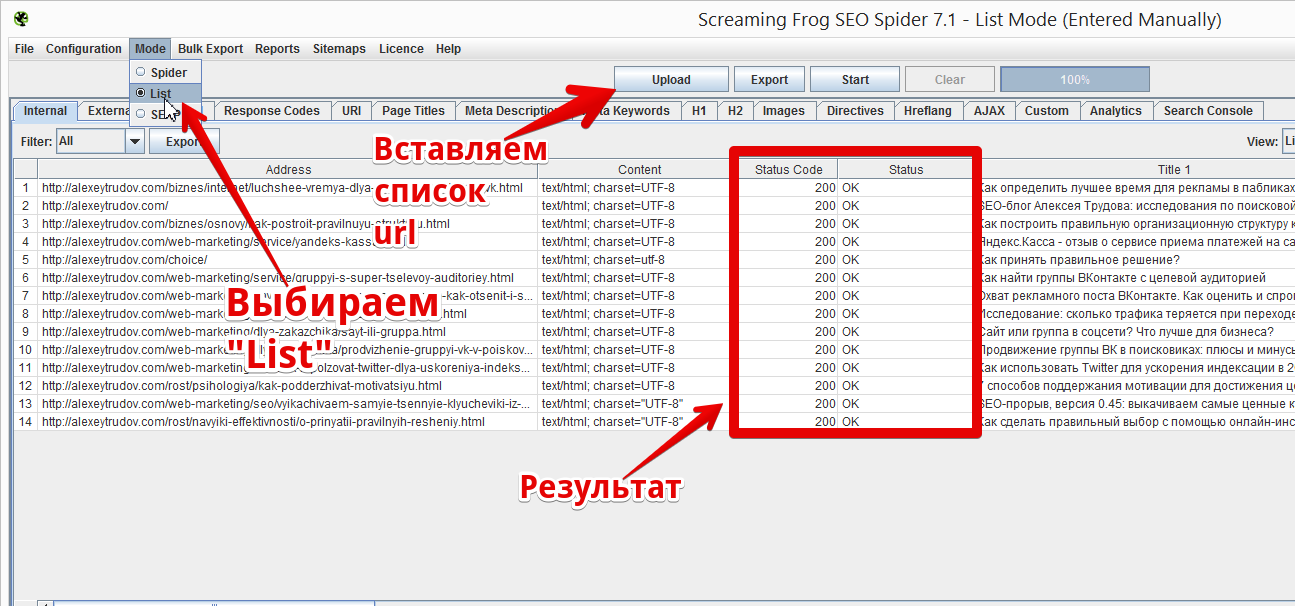

Для начала проверим ответ сервера, который возвращает страница. Это можно сделать, например в Sreaming Frog (возможностей бесплатной версии достаточно):

Также вы можете использовать пробную версию парсера от Visual SEO Studio, о которой я писал в посте о бесплатных программах для анализа сайта.

Какие коды мы можем получить? В большинстве случаев это будет:

- 200 (страница доступна) – нужно работать дальше и рассматривать другие гипотезы.

- 301/302 (переадресация) – вероятно, адрес страницы был намеренно изменен. Стоит проверить, все ли в порядке у страницы, которая является целью редиректа.

- 404 (страницы нет) – очень частый вариант. Раз страница когда-то приносила неплохой трафик, удаление, скорее всего, произошло по ошибке. Страницы с 404 не могут долго находиться в индексе поисковиков и приносить трафик. Стоит позаботиться о ее восстановлении.

- 500/504 (ошибка сервера) – явный признак технических проблем. Необходимо разобраться в причинах и позаботиться, чтобы документ отдавал код 200 и имел корректный контент.

Запрет индексации

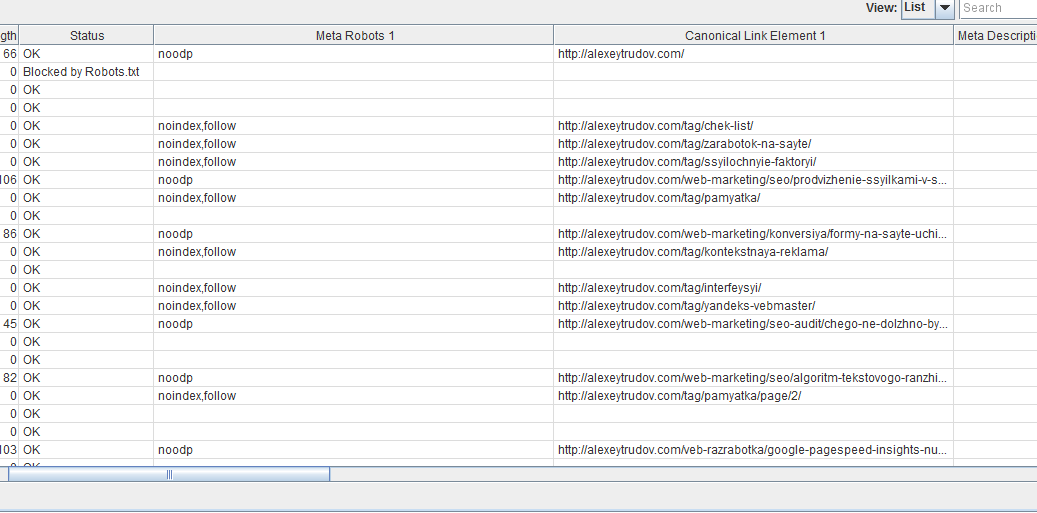

Еще одна распространенная причина – случайный запрет индексации страниц. Возвращаемся к программе, которой мы смотрели ответ сервера и ищем в таблице результатов следующее:

- результаты проверки robots.txt (в Screaming Frog – поле “Status”)

- результаты проверки meta robots

- link canonical

Если страница:

- заблокирована в robots.txt

- или имеет мета-тег noindex

- или имеет отличающийся от ее адреса canonical,

то проблема, скорее всего, в том, что настройки сайта препятствуют индексации документа. Необходимо разобраться, был ли запрет сделан намеренно или случайно. Если запрет случаен – то нужно изменить настройки так, чтобы поисковые системы могли добавлять проблемный url в поиск.

Неактуальный или некачественный контент

Если вы до сих пор не определили причину, по которой страница перестала давать посетителей, то приготовьтесь к чуть более сложному анализу. Нужно понять, может ли контент, имеющийся на странице, вообще приносить посетителей. Дать однозначную инструкцию здесь невозможно: очень много зависит от ниши и специфики сайта.

Вот несколько общих направлений для анализа:

- Содержит ли страница контент, который отвечает какой-либо пользовательской потребности (узнать новые сведения, заказать товар или услугу и т.д.)?

- Достаточен ли объем контента, чтобы адекватно ответить пользователю с поиска?

- Не является ли страница дублем другой страницы (не обязательно полным)?

- Соблюдены ли базовые технические требования к оптимизации (текстовый контент выводится непосредственно в код html-страницы, она имеет корректные title и h1)?

Наконец, страница сама по себе может быть в полном порядке, но содержать контент, который в данный момент не ищут. Скажем, она посвящена новогодним салатам (их ищут раз в год) или старой новости (когда-то она собрала событийный трафик, а сейчас просто устарела). Обычно с такими страницами нет смысла что-то делать. С другой стороны, если реально качественный контент просто пылится в архиве, можно попробовать подобрать под него более актуальные ключевые слова и чуть-чуть сместить на них акцент.

Например, у нас есть новость с заголовком “Аномальная активность клещей в 2012 году”, а внутри – комментарий эксперта, как защитить себя от укуса. Ставим в заголовок “Профилактика укуса клещами: как защитить себя во время вспышки энцефалита”, добиваемся чтобы советы было максимально удобно расположены на странице – и стабильно получаем трафик по информационному ключевику.

Отсутствие в индексе

Даже когда технические настройки не препятствуют индексации и страница содержит качественный контент, это не гарантирует ее присутствие в индексе. Поэтому последним этапом – проверяем наличие страницы в поиске:

- в Google – через оператор info:

- в Яндексе – через оператор url:

(после оператора – проверяемый url).

Если страница не в индексе – добиваемся, чтобы робот мог ее легко найти:

- ставим ссылки с других страниц сайта

- ставим ссылки с Twitter (см. инструкцию по ускорению индексации с его помощью)

- добавляем в “переобход страниц” у Яндекса https://webmaster.yandex.ru/site/indexing/reindex/ и инструмент “Сканирование url” в Search Console https://www.google.com/webmasters/tools/submit-url?hl=ru

- добавляем в карту сайта.

Разумеется, могут иметь место и более экзотические проблемы, которые не вписываются в эту схему. Если вы столкнулись с такой, можете написать мне, я попробую разобраться в ситуации.

Вместо заключения. Еще раз, зачем нужны все эти мучения?

Как видите, задача, особенно если выполнять ее полностью вручную, без использования https://bez-bubna.com/ требует довольно много усилий. Хотя большинство операций просты, времени на детальный анализ уходит порядочно. Стоит ли игра свеч?

Однозначно стоит!

Думаете напрасно в начале этой статьи фото акулы? Анализ проблемных страниц – это один из способов выловить серьезные проблемы с технической частью. По наводке инструмента были обнаружены, например:

- закрытие в robots.txt раздела сайта на 500 страниц;

- неправильная смена структуры сайта (вместо редиректа по старым адресам отдавался 404, все накопленные факторы были растрачены впустую) и как следствие серьезная просадка позиций;

- нерабочий код (у ряда url вместо контента на страницу вываливались технические сообщения об ошибке php).

Впрочем, мелкая рыбешка – возврат трафика на отдельные страницы – тоже приемлемая цель, с хорошим соотношением затраты/результат.

Удачной рыбалки, успехов вашим сайтам!

За инструмент спасибо)

На здоровье)

вот этот вася собирает бесплатно ссылки со всех посетителей со всех блогов которые видит.

Да мне не жалко, ссылки все равно выключены, только название домена.

*Комментарий я отредактировал, здесь не матерятся.

Как раз работаю над этим после анализа сайта в bez-bubna.com, а тут ВАша статья – благодарю! – всё же легче теперь разобраться что и как смотреть.

Я тут опять стучусь по поводу синонимов ключевых запросов – очень нужно понять, где они есть и как искать (кроме Кей Коллектора). Заранее спасибо.

Галина, пожалуйста, собственно я писал статью как основу справки для bez-bubna.com.

По поводу синонимов – пока в работе, по срокам сложно сказать, там есть нюансы.

Поюзал как-то – действительно сервис круче работает чем все SEO-аудиты, что я когда либо заказывал вместе взятые. Но для основного проекта анализ оказался кэпским, ибо часто заглядываю в метрику, и анализирую, смотрю что куда и где.

Кстати – вот ты тут анализируешь страницы входа. А я всегда смотрю по заголовкам страниц. Ибо страницы входа могут измениться, а заголовки обычно не меняют. Хотя и заголовки тоже меняться могут. Короче вот этот момент учитывается ли при анализе? Т.е надо не только по урлам смотреть, но и по тайтлам.

Спасибо!

Да, лучше всего работает на немного заброшенных/до этого незнакомых проектах (потому что создавался на основе скриптов, которые я сам использовал для аудита сайтов клиентов). Сознательно избегаю особо сложных вещей, чтобы не сужать ЦА.

По идее да, много что в алгоритме можно уточнить. Пока только по урлам.

За инструмент большое спасибо, да и за статью тоже!

Рад, что понравилось! Пользуйтесь, надеюсь скоро выпустить еще инструментов (но сначала релиз основного сервиса)

Алексей, привет!

У меня такая проблема – владею киносайтом, который буквально месяц назад имел трафика около 50К в день. После блокировки Роскомнадзором, трафик просел, на старые новости не вернулся, новые тоже дают всего 3-4К в день вместе. Устал уже играться с ключами, проблем, описанных в статье, не нашел, подскажите, можно ли что-то сделать?

Александр, после недоступности так играться нет смысла. По всей видимости, она режет хостовые факторы. Вот старый кейс: что произошло с трафиком после недоступности сайта. Плюс аналогичные наблюдения в довольно чистом эксперименте из моего свежего доклада (скоро выложу).

Спасибо за методику и инструмент, вы сэкономили кучу моего времени!

Отлично, спасибо что пользуетесь!

Спасибо за сервис, оч круто! После анализ сайта, вышло 2000 новостей, которые уже не актуальны. Что с ними делать, удалять или оставить как есть? Удаление такого объема страниц может привести к проблемам?

Ильдар, рад, что понравилось.

Обычно старые новости не представляют проблемы, архив есть на многих сайтах. Но если испытываете проблемы с Google, обратите внимание: https://alexeytrudov.com/google-fred

Алексей, а в вашем сервисе как происходит подсчет динамики трафика? Также, сравнивается период “последний месяц” и “год”?

Там есть разные инструменты, сравниваются разные периоды. Если речь про тот, что нацелен именно на страницы с пропавшим трафиком, то да, 10 или 12 месяцев и последний месяц.

Алексей, скажите пожалуйста, а если на сайте была только Гугл Аналитика, есть ли подобный алгоритм там и могли бы вы мануал описать по аналогии к этому, на на примере Аналитика?

Да, там все аналогично, нет принципиальной разницы что использовать, Analytics или Метрику.

Возможно как-нибудь соберусь и напишу, хотя пока не до того совсем 🙂